Introducción

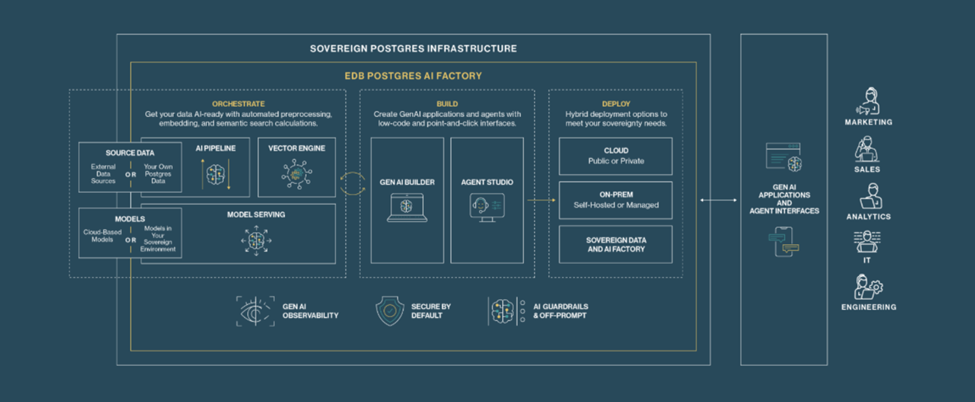

EnterpriseDB (EDB) ha actualizado recientemente su plataforma y ecosistema de productos que operan en torno a PostgreSql , para adaptarlos y enfocarlos a la nueva forma de trabajar que se está implantando y que cada vez más se integra en nuestro día a día, que es la inteligencia artificial (AI) generativa. EDB a esto le ha denominado EDB Postgres AI Factory

Vamos a realizar una serie de blogs comentando los conceptos y elementos más importantes de esta nueva plataforma que EDB está impulsando y que poco a poco irá integrando y evolucionando todo el ecosistema Postgresql para dar mayor visibilidad y potencia a la infraestructura y bases de datos PostgreSql.

¿Qué es Postgresql AI?

Básicamente es la integración del ecosistema de Postgresql con las capacidades generativas avanzadas de AI. Esto nos permite crear, implementar y gestionar sistemas inteligentes en nuestros entornos, aprovechando las cargas de trabajo y los procesos de análisis con AI.

Lo realmente interesante de este nuevo enfoque es que se puede realizar sobre nuestros propios datos, aislarnos del resto de entornos o modelos LLM públicos. Lo que hace que podamos evolucionar nuestra infraestructura a otro nivel, al darnos una visión avanzada a partir de nuestra información o datos.

¿Cómo integramos nuestros datos con la AI?

Para poder integrar nuestros datos con AI, lo que necesitaremos es un lugar donde poder almacenar nuestros datos, ya sea de nuestras bases de datos o de otras fuentes . EDB lo denomina como EDB Postgres® AI Analytics Acelerator. Básicamente se trata de un DataLake[1]1 para almacenar todos nuestros datos de múltiples fuentes.

Una vez que tenemos nuestras fuentes de datos, lo que EDB propone es dotar a nuestra infraestructura de esa AI. Para ello necesitaremos transformar nuestros datos (a través de los AI pipelines y vector engines, entre otros componentes) para que el sistema sea capaz de almacenar y mantener los datos de una manera que la AI pueda identificarlos y podamos realizar búsquedas de los datos que nos interesan.

¿Cómo gestionamos todos los componentes de nuestra GenAI?

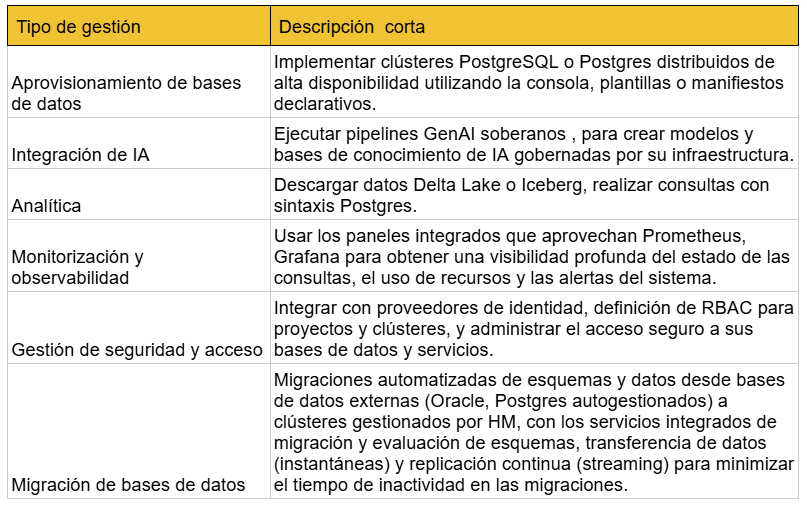

A pesar que la integración de AI con nuestras bases de datos se puede simplificar bastante respecto a otros modelos existentes, la gestión y automatización de todos los procedimientos o componentes puede ser complicada. Por eso EDB incorpora también el EDB Postgres AI Hybrid Manager (HM) , para gestionar no solo la parte de AI que incorpora Enterprisedb, sino también la gestión de postgresql, ya sea que esté desplegado en entornos híbridos, locales o en la nube. Que podemos gestionar con HM:

En próximos blogs iremos comentando estos interesantes avances que EDB está introduciendo en su plataforma para proporcionar a PostgreSQL unas capacidades adicionales para la gestión de nuestros datos.

FAQ (Preguntas frecuentes)

Es el nombre que EDB da a la actualización de su plataforma y ecosistema en torno a PostgreSql para integrar capacidades de inteligencia artificial (AI) generativa en la forma de trabajar con datos e infraestructura.

Es la integración del ecosistema de Postgresql con las capacidades generativas avanzadas de AI, para crear, implementar y gestionar sistemas inteligentes en los entornos, aprovechando las cargas de trabajo y los procesos de análisis con AI.

Porque permite realizar este enfoque sobre datos propios y aislarse del resto de entornos o modelos LLM públicos, obteniendo una visión avanzada a partir de la información o datos.

EDB lo denomina como EDB Postgres® AI Analytics Acelerator. Básicamente se trata de un DataLake para almacenar todos nuestros datos de múltiples fuentes.

- [DataLake] Es un repositorio centralizado que almacena grandes volúmenes de datos en su formato nativo, sin procesar ni transformar, provenientes de diversas fuentes ↩︎